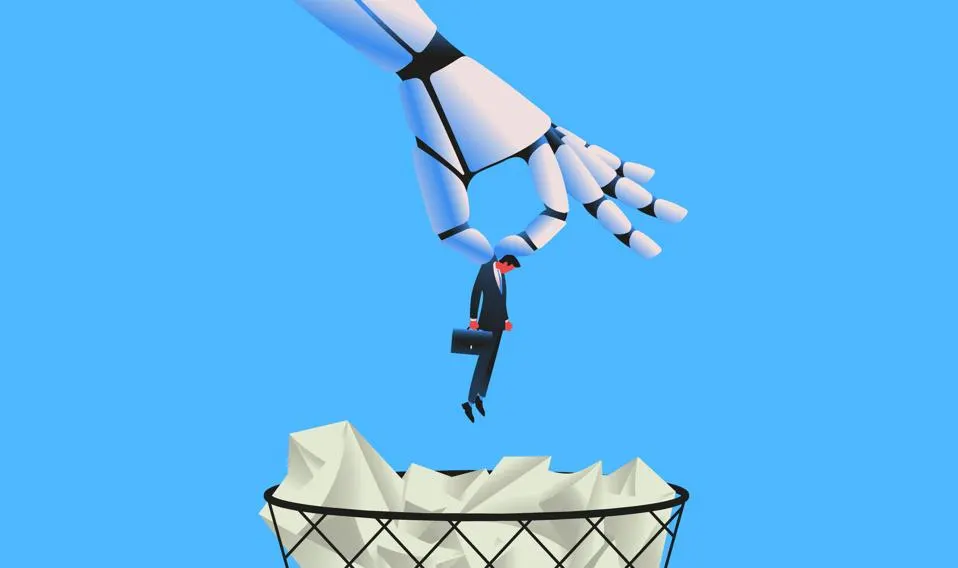

La Comisión Federal de Comercio de Estados Unidos (FTC) abrió este jueves una investigación sobre siete grandes tecnológicas por los posibles daños que los chatbots de inteligencia artificial podrían causar a niños y adolescentes.

La pesquisa se centra en herramientas conversacionales diseñadas para actuar como acompañantes virtuales —imitando emociones y actitudes humanas— lo que podría llevar a que menores establezcan vínculos de confianza con ellas.

Las órdenes fueron enviadas a Alphabet (Google), Character.AI, Instagram y Meta, OpenAI, Snap y xAI de Elon Musk. La agencia busca información sobre cómo estas compañías evalúan el impacto en usuarios jóvenes, las medidas de protección implementadas y la manera en que informan a los padres.

La investigación surge tras demandas que vinculan a chatbots con suicidios, explotación sexual y otros daños, incluyendo procesos legales en curso contra OpenAI y Character.AI.

Organizaciones como Common Sense Media han pedido que estas aplicaciones no estén disponibles para menores de 18 años. En California, dos proyectos de ley sobre seguridad de chatbots para menores podrían ser votados esta semana, mientras que el Senado federal celebrará una audiencia titulada “Examinando el daño de los chatbots de IA”.

El presidente de la FTC, Andrew Ferguson, afirmó que el estudio busca comprender cómo las empresas monetizan la interacción de los usuarios, desarrollan sus productos y mitigan riesgos para los menores, sin frenar la innovación de la industria.

OpenAI respondió que su prioridad es la seguridad y que planea implementar controles parentales. Google, Snap y xAI no respondieron de inmediato a los pedidos de comentarios.