A medida que el contenido generado por inteligencia artificial de baja calidad se multiplica en internet, plataformas digitales y desarrolladores intensifican los esfuerzos para contener la difusión masiva de imágenes y videos considerados insípidos, repetitivos o engañosos, fenómeno conocido como “basura de IA” o AI slop.

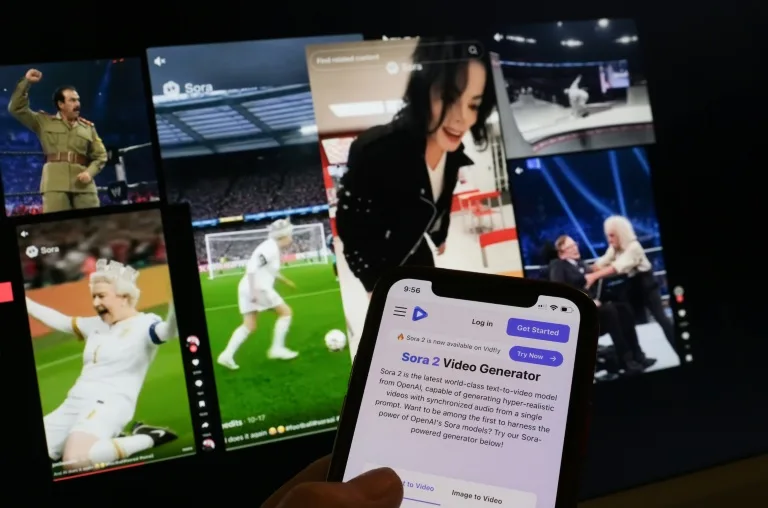

Imágenes de gatos pintando cuadros, celebridades en situaciones falsas o personajes animados promocionando productos forman parte de este tipo de contenidos, producidos con herramientas de acceso sencillo como Veo, de Google, o Sora, de OpenAI. El término ha ganado relevancia en el debate público y dentro de la industria tecnológica.

“El auge de la IA ha causado dudas sobre el contenido de baja calidad, también conocido como basura de IA”, señaló Neal Mohan, director ejecutivo de YouTube. Para el ingeniero suizo Yves —quien prefirió no revelar su apellido— este material es “barato, insípido y producido en masa”.

Desde otra postura, el director ejecutivo de Microsoft, Satya Nadella, ha llamado a dejar atrás el debate y adoptar la inteligencia artificial como una herramienta para amplificar la creatividad y la productividad, en un contexto donde la empresa figura entre las que más invierten en este tipo de tecnología.

Bob Doyle, creador de contenido especializado en IA, sostiene que la crítica a la llamada basura de IA es, en el fondo, una crítica a la expresión creativa individual. Sin embargo, la presión de los usuarios ha llevado a varias plataformas a implementar mecanismos para limitar su exposición.

Pinterest informó que desarrolló un filtro específico tras recibir solicitudes de usuarios que buscaban ver menos imágenes generadas por inteligencia artificial. TikTok introdujo una herramienta similar a finales del año pasado. YouTube, así como Instagram y Facebook —propiedad de Meta—, ofrecen opciones para reducir este tipo de contenido, aunque sin filtros claramente identificables.

Plataformas más pequeñas también han tomado medidas. Coda Music, con alrededor de 2 mil 500 usuarios, habilitó funciones para reportar contenido generado por IA y permite bloquearlo por completo. Su fundador y director ejecutivo, Randy Fusee, señaló que ha habido una alta participación de la comunidad en la identificación de artistas creados con inteligencia artificial.

Por su parte, Cara, una red social enfocada en artistas y diseñadores que supera el millón de usuarios, implementó una combinación de algoritmos y moderación humana para filtrar este tipo de publicaciones. “La gente quiere la conexión humana”, afirmó Jingna Zhang, fundadora de la plataforma.

El debate sobre la inteligencia artificial y la calidad del contenido digital continúa creciendo, mientras usuarios y empresas buscan equilibrar innovación tecnológica con autenticidad y valor creativo en los espacios digitales.